不「看地图」就能自己走的车,也能由毫末智行驱动

超级充电站刚讨论过 GPT 上车没几天,就有厂商带来新进展。

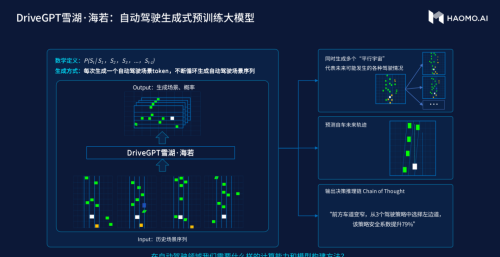

4 月 11 日的第八届 HAOMO AI DAY 上,毫末智行发布 DriveGPT 雪湖·海若,这是用于自动驾驶的生成式大模型,其参数规模已经达到 1200 亿。

DriveGPT 雪湖·海若目前可以在计算中心完成高效的场景识别标注,将每张图片的标注费用从约 5 元下降到 0.5 元。它也会赋能汽车,很快上市的新摩卡 DHT-PHEV 就以此获得城市领航辅助能力。

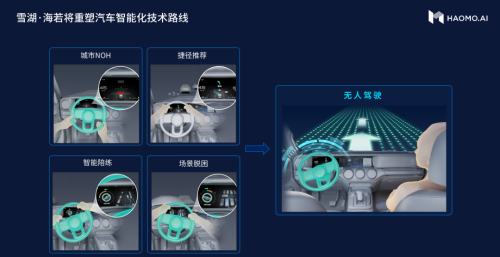

毫末 CEO 顾维灏说,「我们相信 DriveGPT 雪湖·海若将会重塑汽车智能化领域的技术路线。」

ChatGPT 一石激起千层浪,也带来新的设想。

既然能让机器像人一样,对自然语言分析、推演再给出反馈,那么是不是也可用于增强自动驾驶,做到像真正的老司机一样开得又好又快?

观察道路理解正在发生的一切,推演并选择合适路线前行,是所有驾驶者习以为常的事情,也是重感知、轻地图技术方向下,自动驾驶必须达成的目标。而这,恰好也是生成式预训练 Transformer 模型(GPT)的长项。

毫末智行率先公开大模型研发成果,这就是 DriveGPT 雪湖·海若。暂且放下略显枯燥复杂的技术名词,让我先试着用通俗的话语描述它如何工作。

基于从影像翻译成「语言」的当前道路信息,DriveGPT 会预估出数个可能的场景,就像是奇异博士观测无数个未来。

接着它会考虑自己,预测当下这辆车将有怎样的行驶轨迹。最后 DriveGPT 把场景推演和行车轨迹结合起来,大模型的逻辑推理特性,使其确定出符合决策规则的行驶策略。

在经过 4000 万公里以上海量行车数据的训练后,DriveGPT 终于要自己来掌控车辆前行了,当然,是以符合道路交通法规和贴近人类驾驶为前提。

你可以像使用其他的生成式模型那样,用提示词改变它的行为模式,只不过输入方式会是导航路线、司乘语音提示等,开快还是开稳皆由此而定。

DriveGPT 的成果,将首发落地在搭载毫末 HPilot3.0 的新摩卡 DHT-PHEV 上,以城市 NOH 功能呈现。

也就是说,这辆全新的魏牌混动车不会对高精地图有强依赖,它能在城市道路上用「双眼」看路,接着在「大脑」中完成决策,最后自行前往目的地。

城市领航辅助可以丢掉高精地图的「拐杖」,但也要经过充分的验证才会开放给更多用户。

不过,毫末城市 NOH 已经在北京、保定、上海等城市开启泛化测试,到 2024 年时则有望在上百个城市可用,速度比起高投入慢产出的高精地图模式快了很多。

毫末将会通过 DriveGPT,覆盖更多自动驾驶场景的研发,给高速 NOH,城市巡航、驾驶捷径推荐、智能陪练、场景脱困等带去突破。

顾维灏还把目光望向了更遥远的地方:「我们希望能够抵达自动驾驶的终极场景:无人驾驶。」

在这个瞬间,我们似乎离完全自动驾驶更近了一步。

毫末智行称,在乘用车高阶辅助驾驶上,目前已获得三家主机厂定点合同。在更多车型见证 DriveGPT 实力这件事,看来不会让我们等太久。

小鹏、理想等车企也已经开启自动驾驶大模型研发,毫末在这条路上并不孤单。小鹏日前已经在国内数个城市,率先开放了脱离高精地图路线的 XNGP 城区辅助驾驶,领先优势或将在大模型上车后拉得更开。

毫末的另两个动作,倒是把 DriveGPT 的未来走宽了。

一是把朋友变得多多的。

毫末宣布,北京交通大学计算机与信息技术学院、火山引擎、华为云、京东科技、高通、四维图新、英特尔等,成为 DriveGPT 雪湖·海若首批合作伙伴,它的潜力不止于自动驾驶。

能区分驾驶场景和非驾驶场景、理解驾驶环境下任意场景的 DriveGPT,还可用于场景识别标注任务。标注车道线、交通参与者、红绿灯等信息,每张图价格将从约 5 元下降到 0.5 元。

自动标注技术悄然流行,多个技术供应商都展示了自己的相关方案,亦有新势力高管表示,自动标注的成本仅是过去使用人工的十分之一不到,而且半个月就能完成人力一年的需求。

毫末让更多企业能用上大模型,自动驾驶的生产力大爆炸说不定也不远了。

二是让高阶自动驾驶不再「高贵」。

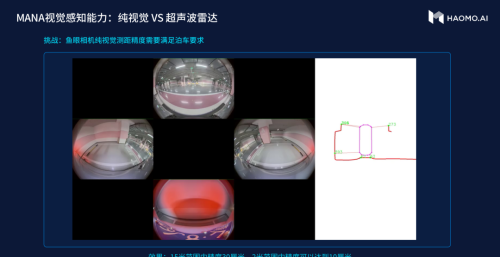

特斯拉激进地采用纯视觉方案,之后又悄然调整找回雷达,让外界对纯视觉有了一些悲观。毫末似乎不认可如此观点,想要在已经成为行业共识的 BEV 方向中,用鱼眼相机替代超声波雷达。

引入视觉感知框架毫末智行的车端鱼眼相机,在当前有着值得另眼相看的视觉精度:在 15 米范围内可达到 30cm,2 米范围内精度则能达到 10cm。

有画面变形缺陷,原本在全场景辅助驾驶难当大用的鱼眼相机,变得颇有「眼力」。

如果该方案能大规模应用,鱼眼相机将代替超声波雷达完成自动驾驶感知工作,大幅降低高阶辅助驾驶使用成本。大疆等辅助驾驶方案商拿出了万元级别的城市 NOA,而鱼眼相机有可能把整套装车开销拉到「白菜价」。

在 2022 年,L2 以上能力装车规模达 585.99 万辆,渗透率达到了 29.40%。毫末智行预测,高阶智能驾驶搭载率将在 2025 年达到 70%,要达成这个规模,自然离不开发展和降本同步推动。

毫末展现了低售价高性能共存的希望,真正的自动驾驶人民之车,可能已经在路上。