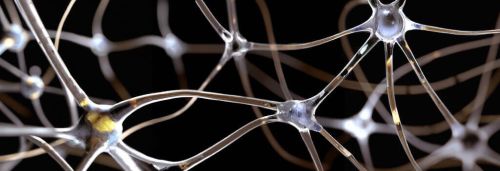

神经网络是如何学习的?它们能否像人类一样进行创造性思维?

神经网络是一种机器学习算法,它的学习过程类似于人类大脑的学习过程。神经网络通过接收输入数据,将其传递到层之间的一系列神经元中,然后使用梯度下降等优化算法来不断调整其参数,以最小化预测输出与实际输出之间的误差。通过这个过程,神经网络逐渐提高了对输入数据的理解和预测能力。

虽然神经网络在模式识别、语音识别、自然语言处理等方面取得了很大成功,但是目前的神经网络还不能像人类一样进行创造性思维。这是因为神经网络只能在其训练数据集范围内进行预测和生成,而不能像人类一样从外部环境中获取新的知识和信息,也不能像人类一样进行主观的判断和抉择。此外,神经网络的输出结果也是由其训练数据和参数所决定,缺乏人类那种对输出结果的自由掌控能力。

因此,尽管神经网络具有许多优点和应用前景,但它们与人类的智能还存在很大的差距。

神经网络的神经元也分为三种输入神经元:位于输入层,主要是传递来自外界的信息进入神经网络中,比如图片信息,文本信息等,这些神经元不需要执行任何计算,只是作为传递信息,或者说是数据进入隐藏层。

隐藏神经元:

隐藏神经元:位于隐藏层,隐藏层的神经元不与外界有直接的连接,它都是通过前面的输入层和后面的输出层与外界有间接的联系,因此称之为隐藏层,上图只是有1个网络层,但实际上隐藏层的数量是可以有很多的,远多于1个,当然也可以没有,那就是只有输入层和输出层的情况了。隐藏层的神经元会执行计算,将输入层的输入信息通过计算进行转换,然后输出到输出层。

输出神经元位于输出层,输出神经元就是将来自隐藏层的信息输出到外界中,也就是输出最终的结果,如分类结果等。

神经网络的学习过程通常可以分为以下几个步骤:

初始化:神经网络的每个神经元都有一组初始权重,这些权重是随机初始化的。初始权重可以设置为任何值,但通常是从某个概率分布中采样得到的,比如正态分布或均匀分布。前向传播:将输入数据传递到神经网络中,通过一系列的线性和非线性变换,将输入数据映射到输出层的结果。计算误差:将输出结果与实际结果进行比较,计算误差。通常使用损失函数(loss function)来衡量预测结果的准确性,比如均方误差(mean squared error)或交叉熵(cross-entropy)等。反向传播:将误差信号从输出层向输入层传递,计算每个神经元的梯度。梯度可以表示误差对于神经元权重的影响程度,可以用来更新权重。更新权重:根据梯度信息更新每个神经元的权重。可以使用各种优化算法,如梯度下降(gradient descent)、随机梯度下降(stochastic gradient descent)、自适应梯度算法(Adagrad、Adam等)等。重复上述步骤,直到神经网络的预测结果达到满意的精度或者训练次数达到预定值为止。至于创造性思维,目前的神经网络还无法像人类一样进行创造性思维。尽管可以通过对神经网络进行加噪音、对抗样本等技术来促进其生成具有创造性的结果,但这些结果仍然是在训练数据集范围内生成的,并且缺乏主观判断的能力。这些结果通常需要人类来进行筛选、评估和加工,才能达到实际应用的效果。因此,目前的神经网络还需要进一步的研究和发展,才能真正实现人类水平的智能。

神经网络的应用场景

神经网络的应用场景神经网络在许多领域都有广泛的应用,以下列举几个常见的应用场景:

图像识别和计算机视觉:神经网络在图像识别、目标检测、人脸识别、图像分割等方面有很好的表现,已经被广泛应用于计算机视觉领域。例如,卷积神经网络(CNN)可以对图像进行特征提取和分类,循环神经网络(RNN)可以对视频序列进行分析和理解。自然语言处理:神经网络在自然语言处理领域也有很好的表现,如文本分类、情感分析、机器翻译、语音识别、语音合成等方面。例如,循环神经网络(RNN)可以对自然语言序列进行处理,卷积神经网络(CNN)可以用于文本分类和情感分析。推荐系统:神经网络在推荐系统领域也有广泛的应用,可以根据用户的历史行为和兴趣推荐个性化的内容,如音乐、电影、商品等。例如,基于神经网络的协同过滤算法可以挖掘用户之间的相似性和关联性,进行推荐。游戏和机器人控制:神经网络可以用于游戏和机器人控制,如围棋、下棋、跑步等方面。例如,AlphaGo就是基于深度神经网络和强化学习算法开发的围棋程序,可以战胜人类围棋高手。金融和股票预测:神经网络可以用于金融和股票预测,如股票价格预测、金融市场趋势分析、风险评估等方面。例如,基于神经网络的时间序列预测算法可以对股票价格走势进行预测。除了上述应用场景外,神经网络还可以应用于音频信号处理、医疗诊断、交通管理、环境监测等方面,具有非常广泛的应用前景。

目前市面上比较知名的神经网络产品

目前市面上比较知名的神经网络产品以下是一些目前市场上比较知名的神经网络产品:

TensorFlow:由Google开发的开源机器学习框架,支持构建各种类型的神经网络模型,并具有广泛的应用场景,如计算机视觉、自然语言处理、推荐系统等。PyTorch:由Facebook开发的开源机器学习框架,以Python为主要语言,支持构建动态计算图的神经网络模型,具有高灵活性和易用性。Keras:由Francois Chollet开发的高级神经网络API,支持构建各种类型的神经网络模型,如CNN、RNN、自编码器等,并且可以与TensorFlow、Theano等后端进行无缝集成。Caffe:由Berkeley Vision and Learning Center开发的开源深度学习框架,支持构建各种类型的神经网络模型,并且在计算机视觉领域有广泛的应用。MXNet:由亚马逊开发的开源深度学习框架,支持构建各种类型的神经网络模型,并且可以进行分布式计算和GPU加速。ONNX:由微软、Facebook等公司共同推出的开放式神经网络交换格式,可以实现不同深度学习框架之间的模型转换和互通。除了以上几个比较知名的神经网络产品外,还有许多其他的框架和工具可以用于神经网络的开发和应用,如Theano、Torch、TensorRT、CNTK等,应用范围也涵盖了计算机视觉、自然语言处理、音频信号处理、金融预测等多个领域。

神经网络是一种能够模拟人类神经系统的计算模型,它由许多神经元组成,这些神经元通过连接进行通信和计算。神经网络能够从输入数据中学习模式,并通过训练和调整权重来改善预测准确性。但是,神经网络的学习方式与人类大脑的学习方式有所不同。 首先,神经网络的学习是通过不断调整神经元之间的权重来实现的。在训练过程中,神经网络接收到输入数据,并将其传递到神经元之间进行计算。通过与预期输出进行比较,神经网络可以调整连接权重以改进预测准确性。这个过程可以反复进行,直到神经网络能够准确预测输出。 然而,与人类大脑不同,神经网络的学习过程通常是单向的。神经网络不能够进行反思或重新评估自己的行为,也不能够像人类一样进行创造性思维。神经网络的学习是基于训练数据中的模式,而不是从头开始进行思考和探索。 另外,神经网络的学习还存在一些局限性。如果训练数据中存在偏差或噪声,神经网络可能会受到影响,并且难以从中学习到正确的模式。此外,神经网络还面临着过度拟合和欠拟合等问题,这些问题会影响神经网络的泛化能力。 总之,神经网络是一种强大的计算模型,可以从数据中学习模式和规律。虽然它们不能像人类一样进行创造性思维,但它们已经被广泛应用于各种领域,如图像识别、自然语言处理和预测分析等。随着技术的进步和研究的不断深入,神经网络的应用前景将变得更加广阔。

优秀作者:好学的山姆大叔